Reconstruction method for three-dimensional temperature field on the aircraft model surface

-

摘要:

针对风洞试验中红外图像分辨率低、测试角度限制导致飞行器表面温度场重建精度不足的问题,提出一种飞行器模型表面三维温度场的重建方法。首先采用基于多帧红外图像的特征点识别算法,对特征点进行识别定位;其次通过面元筛选方法将飞行器模型温度失真区域过滤;最后利用温度赋值将风洞试验获取的多视角温度数据进行还原。试验结果表明:相较于传统单帧识别方案,多帧处理算法可使特征点定位精度提升25%;在低分辨率(≤ 640 pixel × 512 pixel)红外图像环境下,该方法用于飞行器三维温度场重建的特征点识别率可达96.875%,比基于模板匹配和卷积神经网络算法的识别率(93.75%)高,使得重建的三维温度场更加精准。

Abstract:A method for reconstructing the three-dimensional temperature field of an aircraft model surface is proposed to address the issues of low resolution of infrared images and limited testing angles in wind tunnel tests, which result in insufficient accuracy in reconstructing the surface temperature field of the aircraft. Firstly, a feature point recognition algorithm based on multi-frame infrared images is adopted to identify and locate the feature points; Secondly, the temperature distortion area of the aircraft model is filtered through the panel selection method; Finally, the multi view temperature data obtained from wind tunnel tests are assigned using temperature assignment. The experimental results show that compared to conventional single-frame recognition methods, the multi-frame processing algorithm improves feature point positioning accuracy by 25%. Under low-resolution infrared imaging conditions (≤ 640 pixel ×512 pixel), the proposed method achieves a feature point recognition rate of 96.875% for 3D temperature field reconstruction on aircraft surfaces, surpassing both normalized cross correlation and convolutional neural network-based algorithms (93.75%). This advancement significantly enhances the precision of the reconstructed 3D temperature field.

-

0. 引 言

红外热图技术作为风洞测热试验重要的试验技术之一,在高速风洞中应用广泛。利用红外热像仪可以一次获取飞行器表面的大面积红外数据[1],但由于红外图像缺乏被测试验模型的三维空间信息,无法直观观察飞行器模型表面温度分布及准确定位温度异常位置,而建立飞行器模型的三维温度场可有效还原模型的三维空间温度信息,因此飞行器模型表面三维温度场重建对飞行器热防护设计有重要意义。

重建三维温度场的关键是获取红外热像仪与模型之间的相对位置关系[2]。目前基于图像的姿态估计方法分为4类[3]:基于模板匹配算法(normalized cross correlation,NCC)、三维点云匹配、深度学习以及PnP算法。Ulric等[4]将模板库与尺度空间和方向相似性思想相结合进行匹配,吴鹏等[5]在归一化互相关算法的基础上采用和表法以减少计算量。尽管基于NCC已较为成熟,仍存在精度较低、易失效的问题。基于三维点云匹配的方法利用图像的深度信息,通过建立点对点关系来解决问题。如Rusu等[6]提出的基于三维点云匹配特征直方图的方法实现6D姿态描述。但是风洞试验的飞行器模型是提前建模加工出来的,因此不需要增加深度传感器对飞行器模型本身进行重建。近年来基于深度学习和卷积神经网络(convolutional neural networks, CNN)的数值偏差估计方法有所发展。如Wohlhart等 [7]通过使用CNN构建匹配函数,增强了模板匹配方法,使用一种新的视觉损失函数来训练CNN的目标姿态估计。但目前可用于姿态估计研究的数据集多针对光学图像,因此这些方法在应用于相机的姿态估计方面面临挑战。PnP算法是利用n个特征点的2D坐标、它们对应的3D坐标以及相机参数来确定相机姿态。常用的PnP算法包括直接线性变换(direct linear transform, DLT)、EPnP和P3P[8-10]。DLT在相机成像过程中直接建立了一个基于目标点与图像点之间的投影关系的线性方程组,至少需要6对对应特征点。EPnP通过选择特征点,将3D点表示为线性组合,并求解特征点在相机坐标系下的坐标,最后通过特征点在世界坐标系和相机坐标系下的坐标关系来确定姿态。P3P则基于4对特征点之间的几何关系来建立方程,通过求解方程确定姿态。

此外,当红外热像仪测试角度超过自由极角时,辐射强度测量失真将导致测温误差[11-12]。如果忽略测温失真问题将红外数据直接赋值给飞行器模型会造成重建的目标温度场精度较低。

综合上述相机位姿估计方法的优缺点,同时考虑到直接线性变换法更符合坐标系变换的逻辑,故选择此方法求解热像仪位姿。在红外图像与可见光图像的对比中,红外图像往往呈现出较低的对比度与分辨率,这一特性使得特征点的像素坐标在识别过程中面临显著挑战,难以精准定位。为应对这一难题,提出一种特征点像素坐标的识别算法。针对热像仪测温失真问题,提出测温失真飞行器模型区域的温度赋值方法。

1. 飞行器模型表面三维温度场重建方法

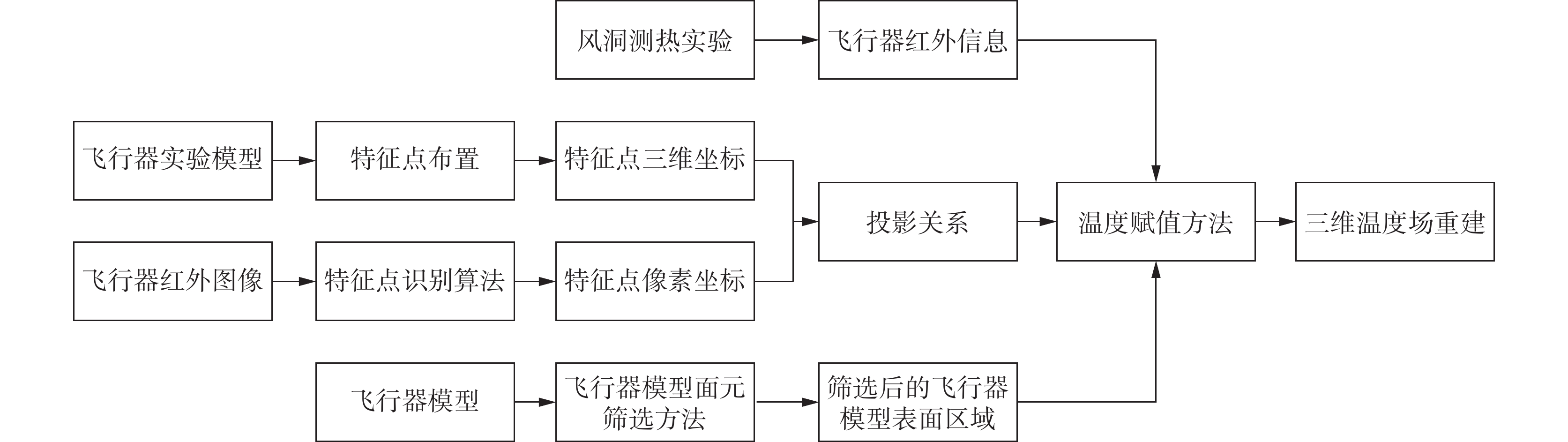

1.1 三维温度场重建流程

本文的三维温度场重建流程如图1所示,为了精确重建飞行器的三维温度场,需获取3个关键信息:1) 飞行器模型红外信息;2) 准确的投影关系;3) 经过筛选的、红外信息准确的飞行器模型表面区域。只有在准确获取三维温度场重建所需信息后,才能利用建立的投影关系,将飞行器的红外信息准确地还原到模型表面,从而完成对飞行器模型表面三维温度场的精确重建。

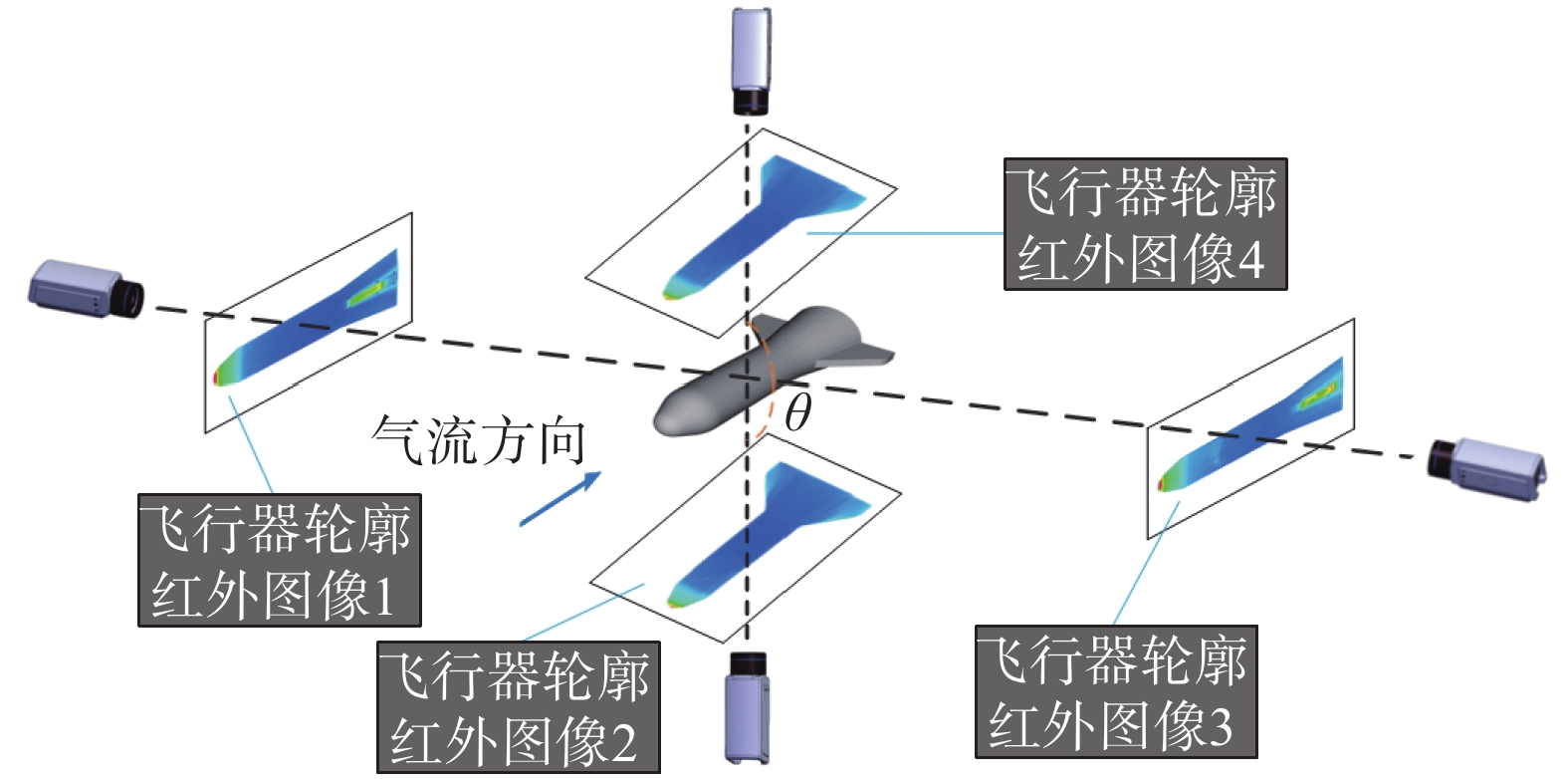

1.2 红外信息采集

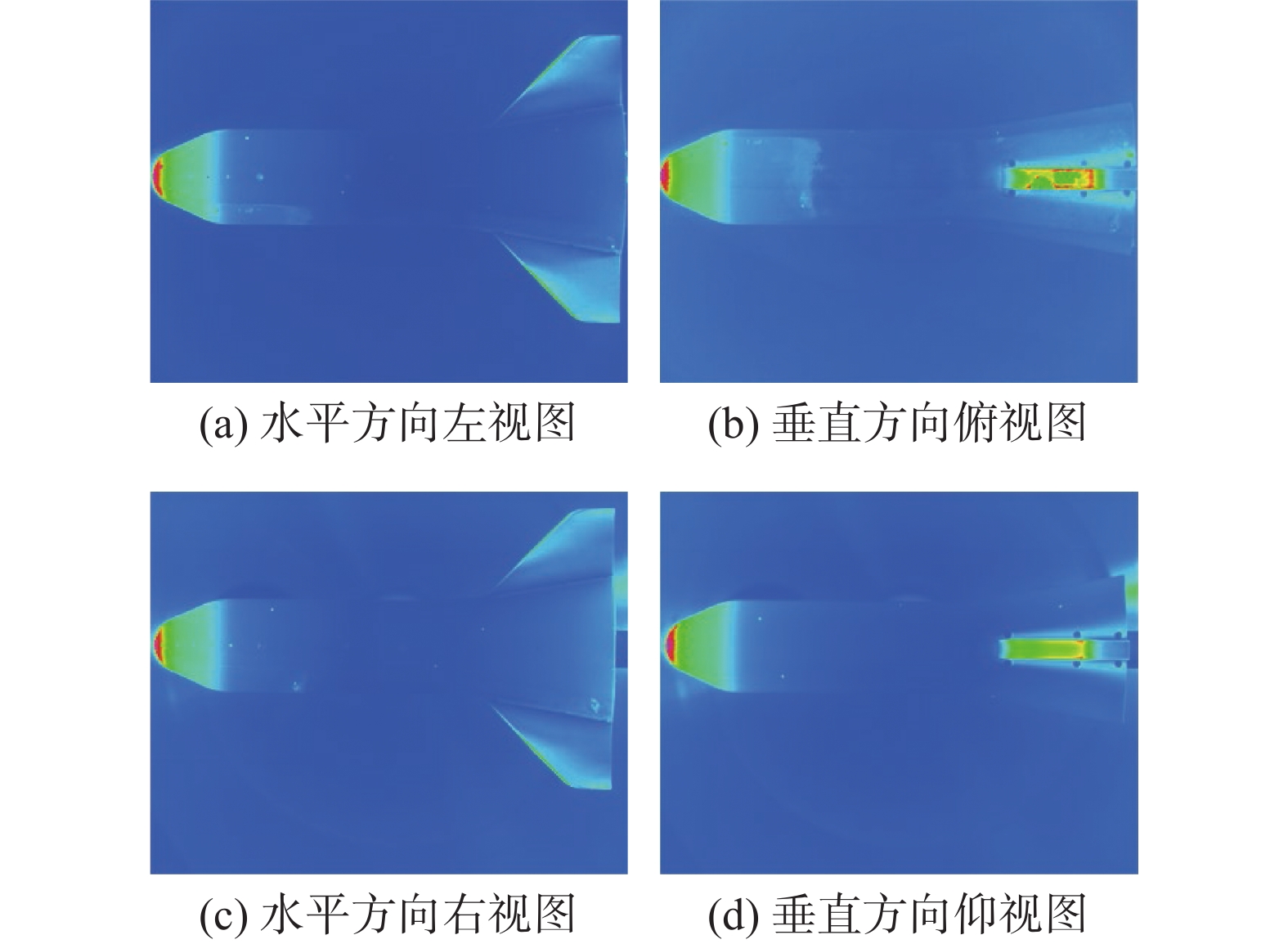

准确获取红外信息对于三维温度场的重建至关重要,风洞测热试验的目的是采集飞行器模型侧表面的红外信息。如图2所示,在风洞试验中,为了获取飞行器侧表面的红外温度信息,使用红外热像仪沿着飞行器模型的水平和垂直方向,同步从4个不同的视角对飞行器侧面进行红外信息的采集。

1.3 特征点识别算法

投影关系如公式(1)所示,热像仪的外部参数T由旋转矩阵R和平移向量t组成,共有6个未知数,故热像仪每个视角下至少需要布置6个特征点。将每个视角下布置的特征点数量增至8个以提高热像仪位姿解的精度。

Zc[uv1]=KT[XwYwZw1]=K[Rt01][XwYwZw1] (1) 式中:(Xw,Yw,Zw)与(u,v)分别是特征点的三维坐标和对应红外图像像素坐标;Zc为尺度因子;K为热像仪内参矩阵。

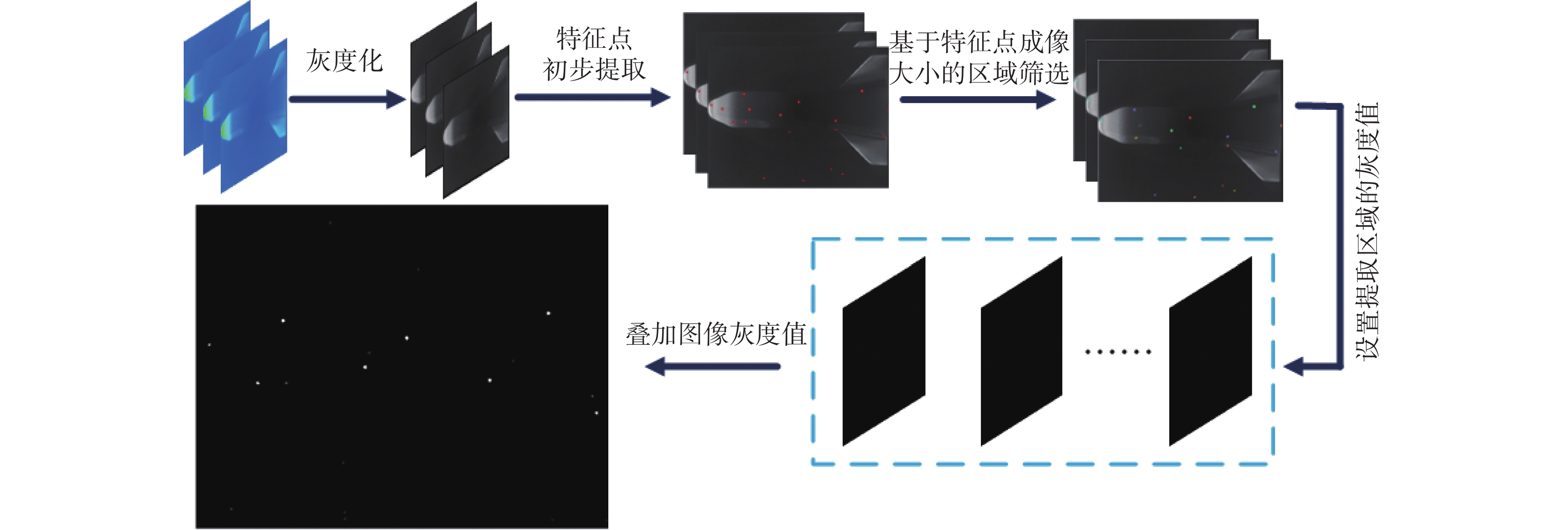

如公式(1)特征点像素坐标的准确度会影响到热像仪位姿解的精度,本文提出的特征点识别算法流程图如图3所示。为了减少图像数据量,首先对红外图像进行灰度化处理。特征点通常表现为图像中的局部高亮区域,采用局部阈值法对其进行初步提取,具体是用一个n×n的像素掩膜在图像上逐像素游走,根据公式(2)的描述,通过比较原图中当前像素和对应掩膜区域像素的灰度均值,找出亮度较高的区域,这些区域即为特征点的初步提取结果。

{c(x,y)=max(S⋅d(x,y),A)Gray(x,y)>m(x,y)+c(x,y) (2) 其中:Gray(x,y)是指原始灰度图像当前像素的灰度值;A为给定的绝对阈值;遍历像素时,m(x,y)、d(x,y)和S分别是掩膜覆盖像素块的平均灰度值,灰度标准差和标准差因子。

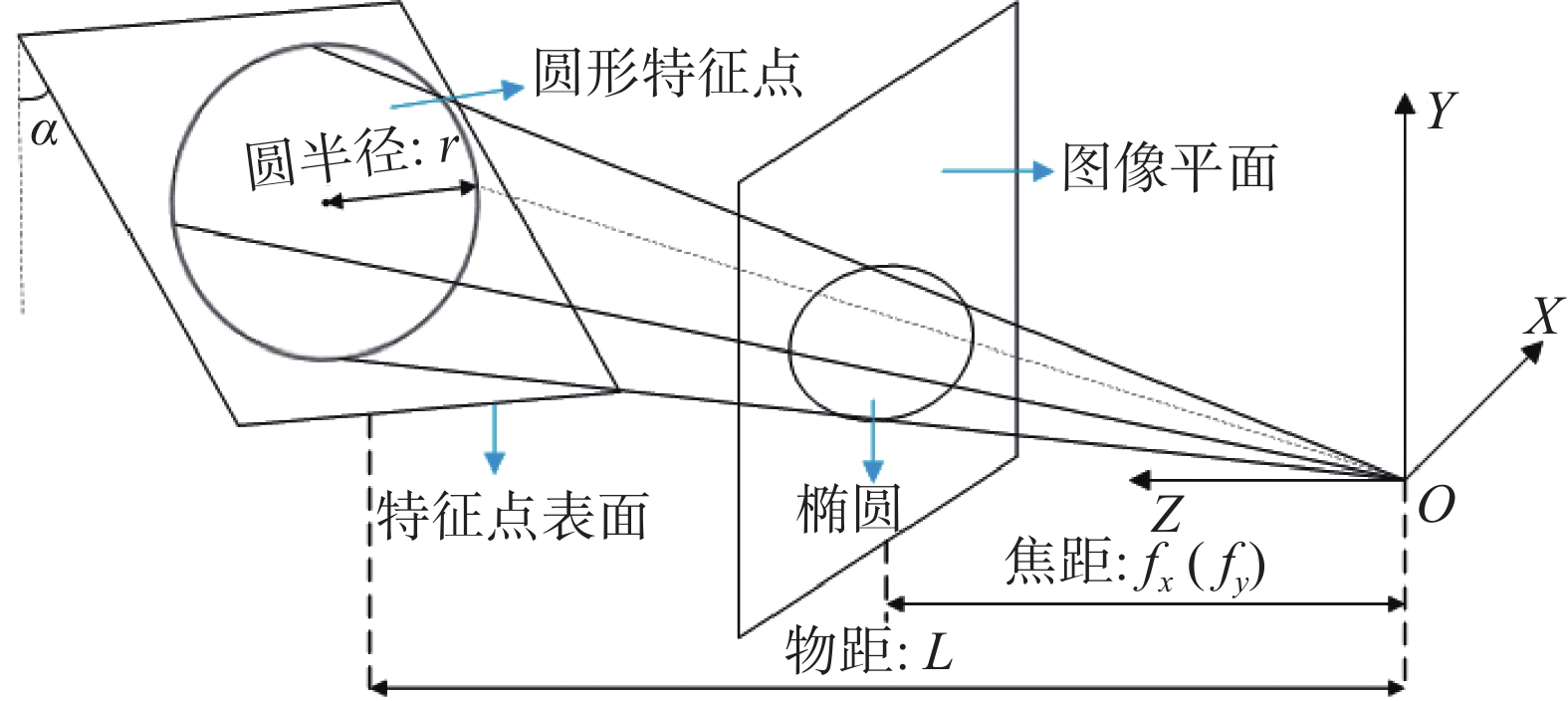

特征点的成像原理如图4所示。利用公式(3)计算其成像大小,当特征点表面的倾角α为0时特征点最大成像为Smax,把Smax作为筛选特征点区域的阈值。

S=π⋅rfxL⋅rfyLcosα (3) 根据公式(4),对从N帧图像中提取的特征点区域执行了一系列处理步骤,包括区域筛选、灰度设置和灰度叠加。在筛选过程中,将面积小于预设阈值Smax的区域的灰度值设为k,而面积大于Smax的区域灰度值设为0,以此筛选掉图像中比特征点面积大的区域。设Aij为第i张图像中的第j个灰度区域。将每个灰度区域Ai掩膜到一张具有相同分辨率但初始灰度值为0的图像上,从而生成新的图像Gi。最后,将得到的N帧图像Gi进行灰度叠加,合成一张新的图像M。

{Aij={k,SAij⩽ (4) 图像 M 中越亮的区域为特征点的可靠度越高,若布置了 m 个特征点,则取平均灰度值最高的 m 个区域作为最终识别的特征点。取区域的质心作为特征点的像素坐标。

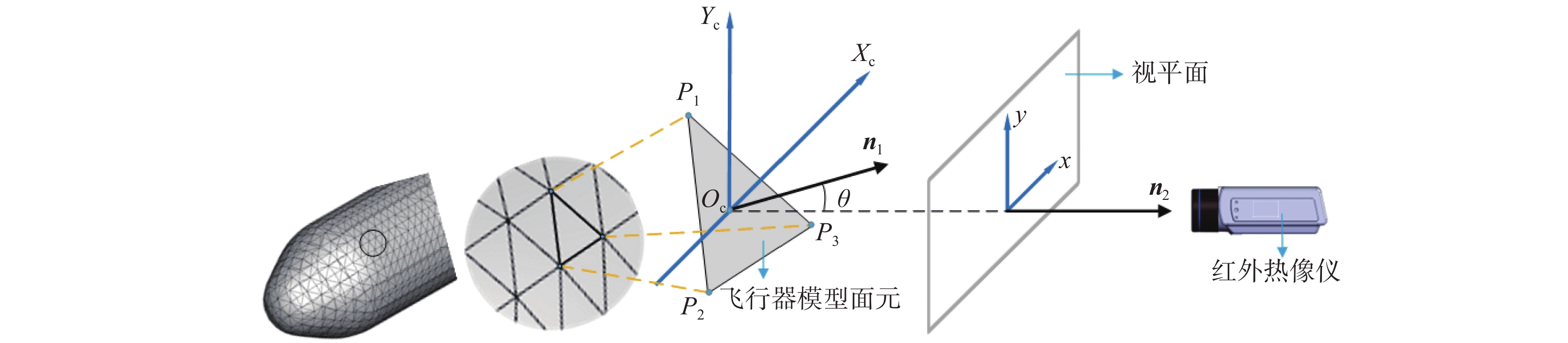

1.4 飞行器模型面元筛选方法与温度赋值

飞行器模型某个面元法向量 \boldsymbol{n}_{1} 与热像仪视平面法向量 \boldsymbol{n}_{2} 的分布情况如图5所示。如果这两个法向量之间的夹角过大,热像仪接收到的辐射信号将会减弱,这将导致温度测量结果的不准确。将这些温度数据用于重建会使得三维温度场精度较低。

针对测温不准确的问题,利用公式(5)将该视角下模型温度异常的区域过滤掉,只将热像仪获取的准确红外信息还原到对应模型区域上。

\left\{\begin{split} \boldsymbol{n}_{1}=&\overrightarrow{{{P}_{1}P}_{2}}\times \overrightarrow{{{P}_{1}P}_{3}}\\ &=({y}_{1}{z}_{2}-{y}_{2}{z}_{1},\;{z}_{1}{x}_{2}-{z}_{2}{x}_{1},{x}_{1}{y}_{2}-{x}_{2}{y}_{1})\\ \boldsymbol{n}_{2}=&\frac{\left({x}_{3}-{x}_{4},\;{y}_{3}-{y}_{4},\;{z}_{3}-{z}_{4}\right)}{\sqrt{{\left({x}_{3}-{x}_{4}\right)}^{2}+{\left({y}_{3}-{y}_{4}\right)}^{2}+{\left({z}_{3}-{z}_{4}\right)}^{2}}}\\ S\left(\boldsymbol{n}_{1},\boldsymbol{n}_{2}\right)=&\left\{\begin{array}{ll}1,&{\mathrm{cos}}^{-1}\left(\boldsymbol{n}_{1} \cdot \boldsymbol{n}_{2}\right)\leqslant {\theta }_{{\mathrm{max}}}\\ 0,&{\mathrm{cos}}^{-1}\left(\boldsymbol{n}_{1} \cdot \boldsymbol{n}_{2}\right) > {\theta }_{{\mathrm{max}}}\end{array}\right. \end{split}\right. (5) \$

如图5,式(5)中 \boldsymbol{n}_{1} 是由空间点P1、P2和P3构成的三角形面元的法向量,假设 \overrightarrow{{{P}_{1}P}_{2}}=({x}_{1},{y}_{1},{z}_{1}) , \overrightarrow{{{P}_{1}P}_{3}}=({x}_{2},{y}_{2},{z}_{2}) ; \boldsymbol{n}_{2} 是热像仪视平面的法向量,标定热像仪获得其位置 c({x}_{3},{y}_{3},{z}_{3}) 和焦点 F({x}_{4},{y}_{4},{z}_{4}) ; S\left( \boldsymbol{n}_{1} , \boldsymbol{n}_{2} \right) 是面元筛选函数, \theta 是 \boldsymbol{n}_{1} 和 \boldsymbol{n}_{2} 的夹角;辐射面最大法向在 {\theta }_{\mathrm{m}\mathrm{a}\mathrm{x}} 范围内,其定向发射率基本不变, {\theta }_{\mathrm{m}\mathrm{a}\mathrm{x}} 大小只与模型的材料有关。本文的飞行器试验模型材料为玻璃钢,根据材料的定向辐射强度特性[13],这里 {\theta }_{\mathrm{m}\mathrm{a}\mathrm{x}} 取60°。

对飞行器某点进行温度赋值时,如公式(6)所示:如果该点所在面元只满足一个视角下的角度要求,那么直接用该视角下的红外信息进行温度赋值;如果该点所在面元同时满足两个视角下的角度要求,使用这两个视角下的红外信息均值进行温度赋值。根据公式(1),当三维点投影到像素坐标,无法恰好对应整数像素格点时,使用线性插值法计算投影点的温度值。

\left\{ \begin{split} &{f}_{q,r}=1,\quad{\theta }_{q,i}\leqslant {\theta }_{\mathrm{max}}\\ &{f}_{q,r}=0,\quad{\theta }_{q,i} > {\theta }_{\mathrm{max}}\\ &T\left(p\right)={T}_{p,r},\quad{f}_{q,r}=1且{f}_{q,s}=0对所有的r\ne s\\ &T\left(p\right)=\frac{{T}_{p,r}+{T}_{p,s}}{2},\\ &\qquad\quad {f}_{q,r}={f}_{q,s}=1且{f}_{q,t}=0对所有的t\notin \left\{r,s\right\} \end{split} \right. (6) 式中: p 是飞行器模型面元 q 中的一个点; r、s、t 表示任意三个热像仪的视角;函数 {f}_{q,r} 用来确定面元 q 是否满足视角 r 的角度要求; {T}_{p,r} 、 {T}_{p,s} 分别是 p 点在视角 r 和视角 s 下测得的温度;定义 T\left(p\right) 是 p 点的温度赋值函数。

2. 三维温度场重建试验及结果分析

2.1 试验设备介绍

试验采用的红外热像仪图像分辨率为640 pixel × 512 pixel,热灵敏度(noise equivalent temperature difference,NETD)为25 mK,测温范围为5~

1500 ℃,帧频调节范围为5~115 Hz。试验使用的透射红外辐射的玻璃材料是氟化钡,透射波段为0.2 ~10 μm,在红外波段具有良好的透过率。飞行器模型的红外信息需要通过风洞测温试验来获取,考虑到红外热图技术在风洞试验中的应用情况,本文选择在高速风洞进行测温试验[14]。试验时会将飞行器模型放置在试验段内,将两台热像仪布置在试验段两侧,马赫数Ma = 10、总温1112 K、总压2 MPa。第二次采集红外信息时将飞行器模型沿轴线旋转90°,通过两次试验可获得飞行器模型四个视角的红外信息。2.2 特征点识别试验

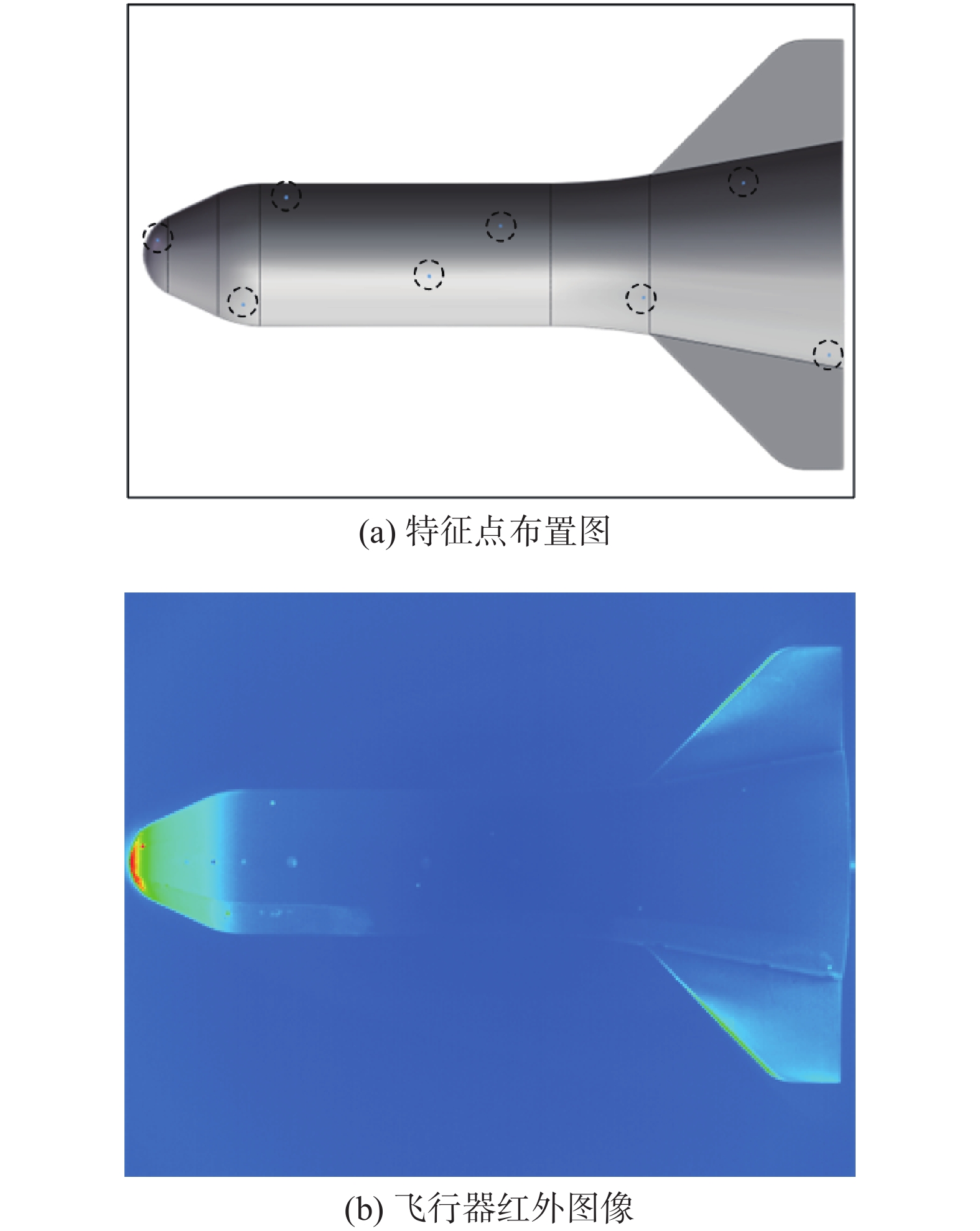

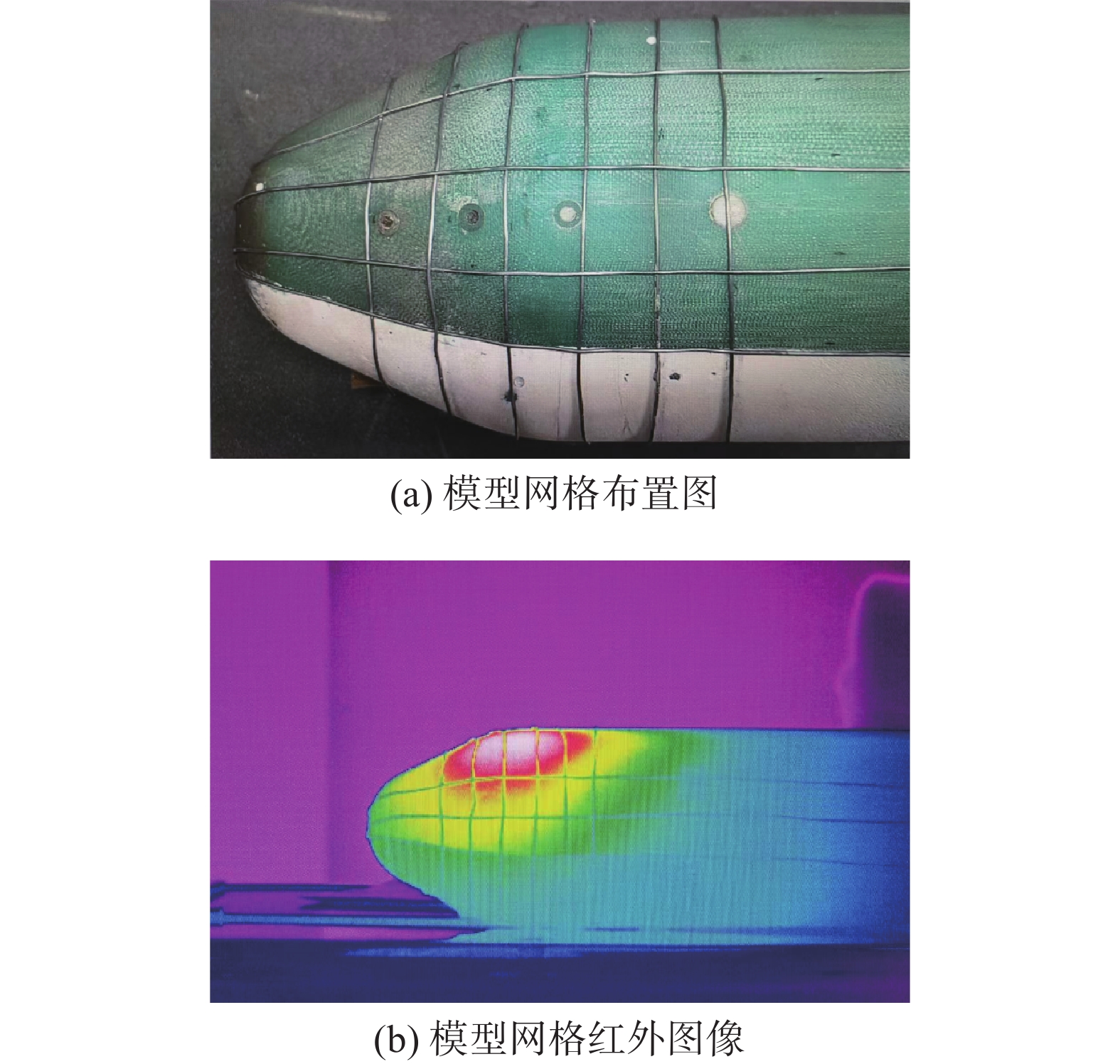

如图6(a)所示,该视角下在飞行器模型上共布置了8个特征点。图6(b)是热像仪获取的一系列红外图像中的其中一帧。

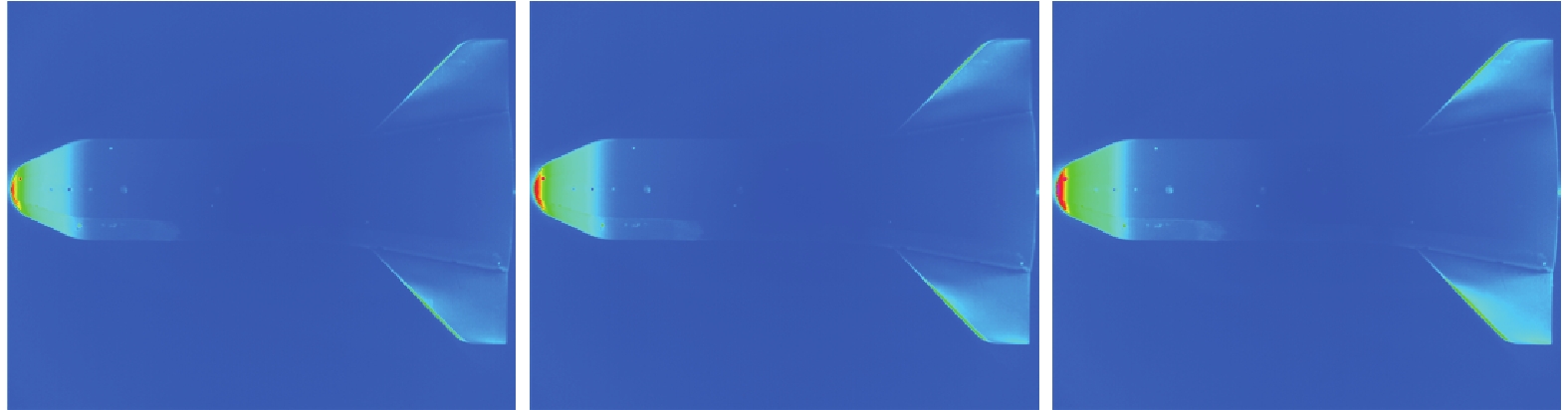

由于在风洞测热试验中红外图像相应区域的亮度会随着被测模型表面温度的变化而变化,如图7所示。因此,要求特征点识别算法具有良好的鲁棒性。利用1.2节提到的特征点识别算法对该视角下红外图像进行处理,每间隔10帧取1帧图像,共选择5帧图像,处理结果如图8所示。

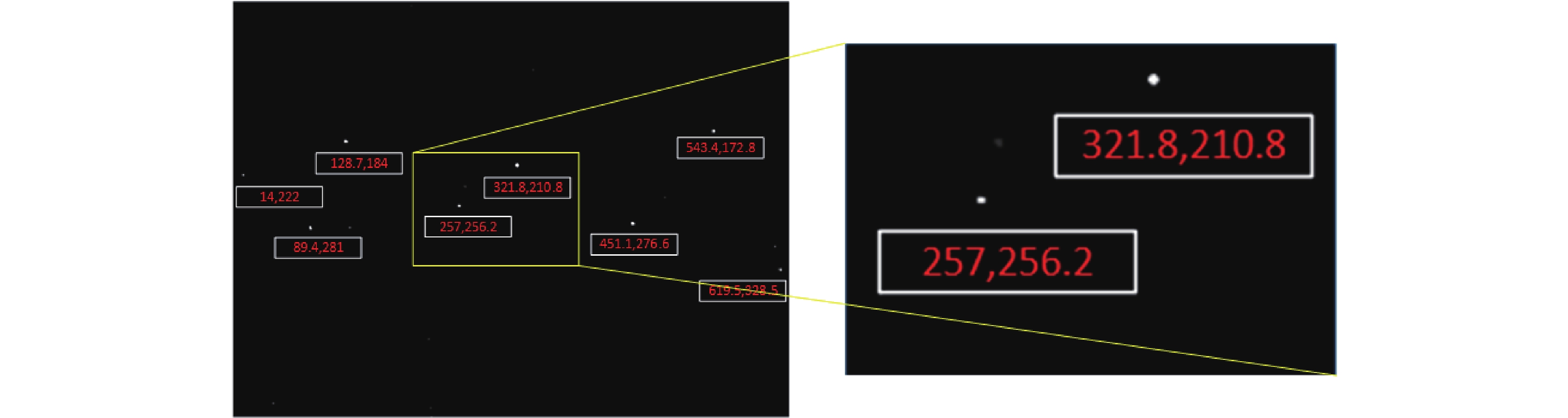

对不同视角下获取的红外图像进行特征点像素坐标识别,改变输入红外图像的帧数,记录特征点识别算法的运行时间及特征点识别率,结果如表1所示。

表 1 不同视角下不同帧数红外图像的特征点识别结果Table 1. Feature point recognition results of infrared images with different frame rates from different perspectives1帧红外图像 3帧红外图像 5帧红外图像 10帧红外图像 20帧红外图像 运行时间/s 识别率/% 运行时间/s 识别率/% 运行时间/s 识别率/% 运行时间/s 识别率/% 运行时间/s 识别率/% 视角1 0.117 87.5 0.343 100 0.576 100 1.136 100 2.143 100 视角2 0.145 75 0.324 87.5 0.502 100 1.202 100 2.342 100 视角3 0.149 75 0.314 100 0.551 100 1.153 100 2.135 100 视角4 0.105 75 0.255 87.5 0.479 87.5 1.067 88.75 2.140 91.25 平均 0.129 78.125 0.309 93.75 0.527 96.875 1.139 97.187 2.190 97.812 由表1可知,单帧图像的特征点识别率较低,随着增加红外图像的帧数,算法运行时间增加,特征点识别率也随之提高。当处理帧数达到5帧时,平均识别率为96.875%,多帧识别精度提升可达25%;但是当帧数超过5帧后,继续增加图像帧数,特征点识别率的提升幅度明显减缓。

采用多种算法(NCC、CNN和本文的特征点识别算法)对每个视角下各5帧红外图像进行特征点像素坐标识别,记录不同算法的运行时间及特征点识别率。结果如表2所示,NCC和CNN算法的平均识别率都为93.75%,可以看出本文的特征点识别算法有着更高的识别率。

表 2 不同算法特征点识别结果Table 2. Recognition results of feature points using different algorithms参数 NCC算法 卷积神经网络 本文特征点识别算法 运行时间/s 3.625 1.782 2.102 平均识别率/% 93.75 93.75 96.875 2.3 热像仪标定精度评估试验

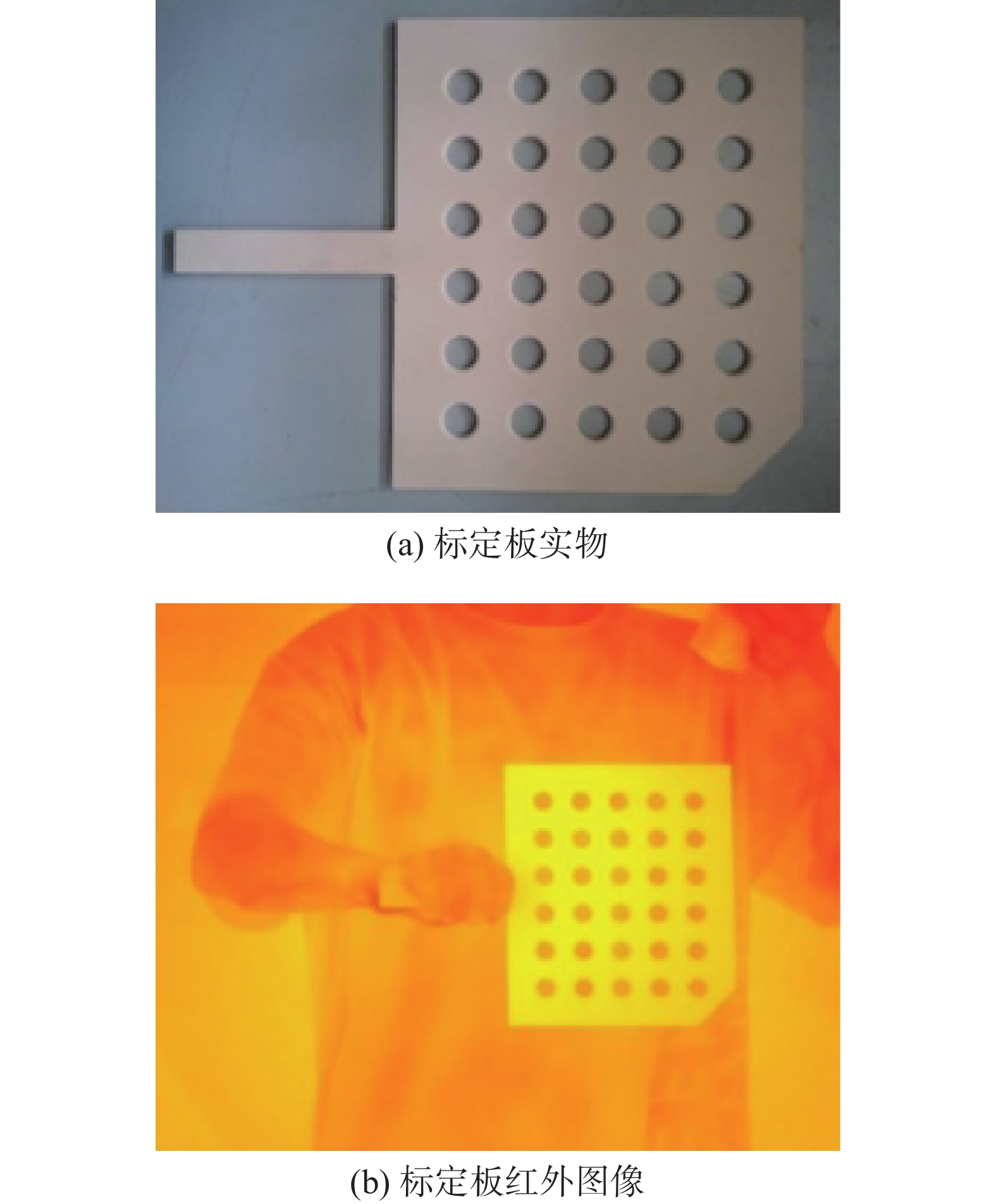

在标定环境下,标定板需要在热像仪中清晰成像,同时考虑到圆形标定板相较于棋盘格标定板在标定精度上的优越性[15-16],本文采用了圆形氧化铝陶瓷标定板,实物如图9(a)。选用了5×6的圆形对称布局标定板,其长方形靶板尺寸为210 mm(长)×180 mm(宽),圆孔直径为30 mm,孔间距30 mm,圆孔分布均匀。使用热像仪采集标定板在不同姿态下的红外图像,图9(b)为热像仪获取的一张标定板图像,并对图像进行了精确校准。

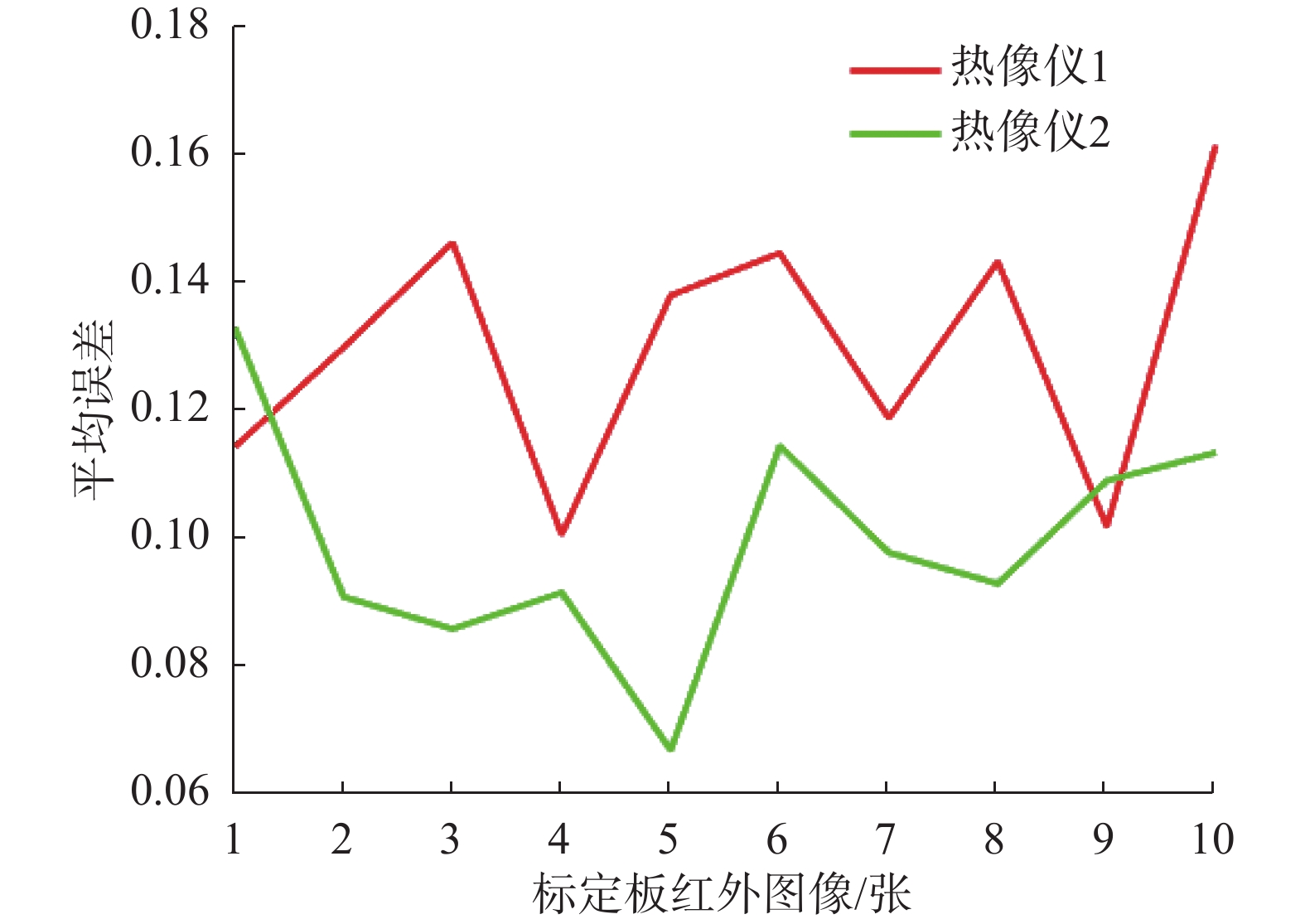

计算标定板红外图像的平均误差,如图10所示,对两台热像仪进行校准后,得到两台热像仪的均方误差分别为0.13和0.10个亚像素。

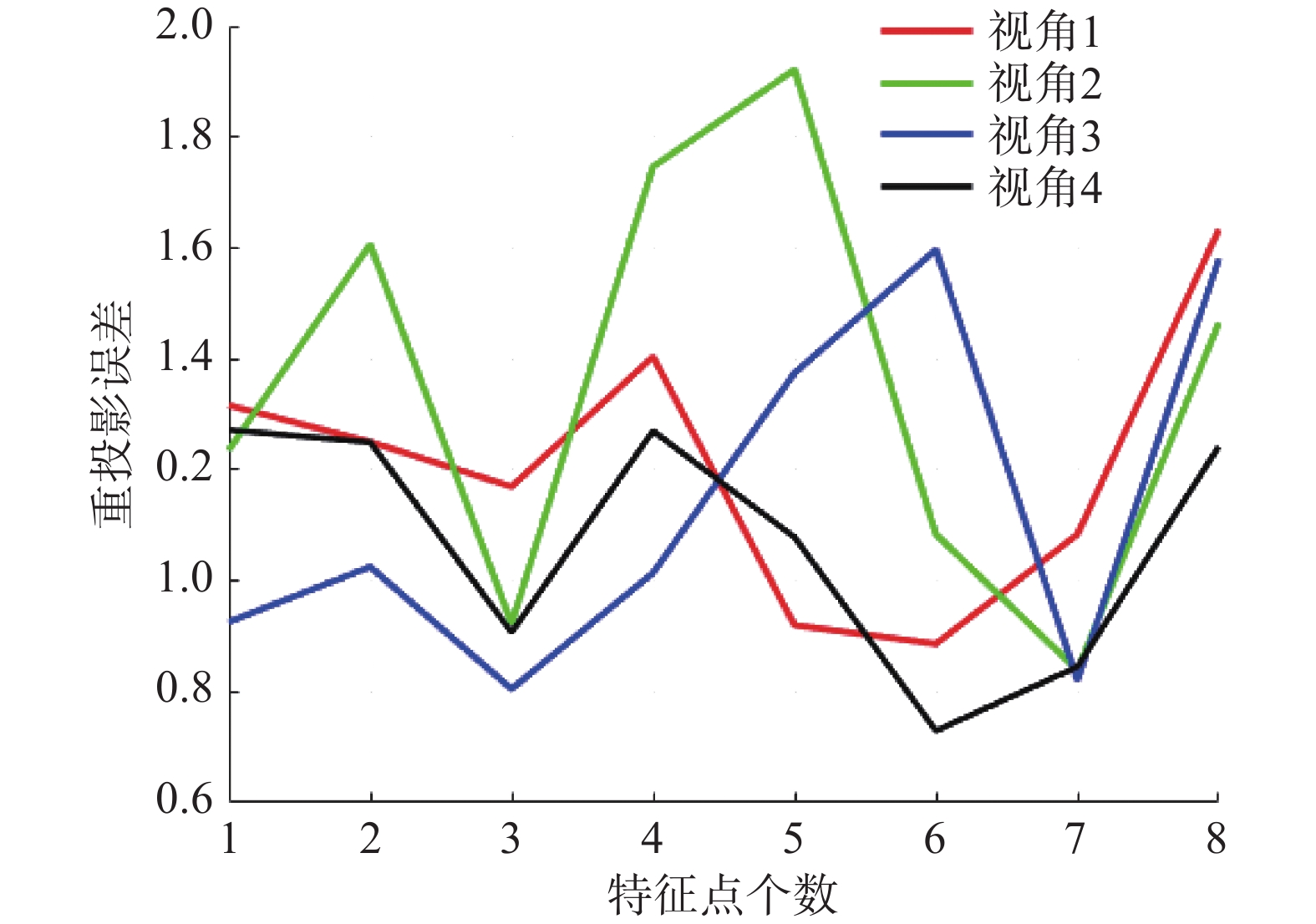

假设在飞行器试验模型上布置的特征点 ({X}_{i},{Y}_{i},{Z}_{i}) ,利用投影关系式(2)将其转换为红外热图中的像素坐标 ({u}_{i}',{v}_{i}') ,计算其与红外热图中成像的特征点坐标 ({u}_{i},{v}_{i}) 的偏差,以此来反映标定试验得到的投影关系的精度。在理想条件下, ({u}_{i}',{v}_{i}') 能够与1.2节中识别到的对应特征点 ({u}_{i},{v}_{i}) 重合。将每个视角下 \left({u}_{i}',{v}_{i}'\right) 与 \left({u}_{i},{v}_{i}\right) 之差的二范数结果作为特征点的重投影误差,其结果如图11所示。利用式(7)求解每个视角的平均重投影误差 {E}_{\mathrm{M}\mathrm{S}\mathrm{E}} 分别为1.207、1.316、1.102、1.076 pixel。

{E}_{\mathrm{M}\mathrm{S}\mathrm{E}}=\frac{1}{n}\sqrt{\sum _{i}^{n}{\left\|\left({u}_{i}',{v}_{i}'\right)-\left({u}_{i},{v}_{i}\right)\right\|}_{2}^{2}} (7) 通过式(7)计算的平均重投影误差越小,标定结果越精准,红外信息对三维点赋值就更加准确,飞行器模型三维温度场的重建精度也就越高。

2.4 飞行器模型表面三维温度场重建结果

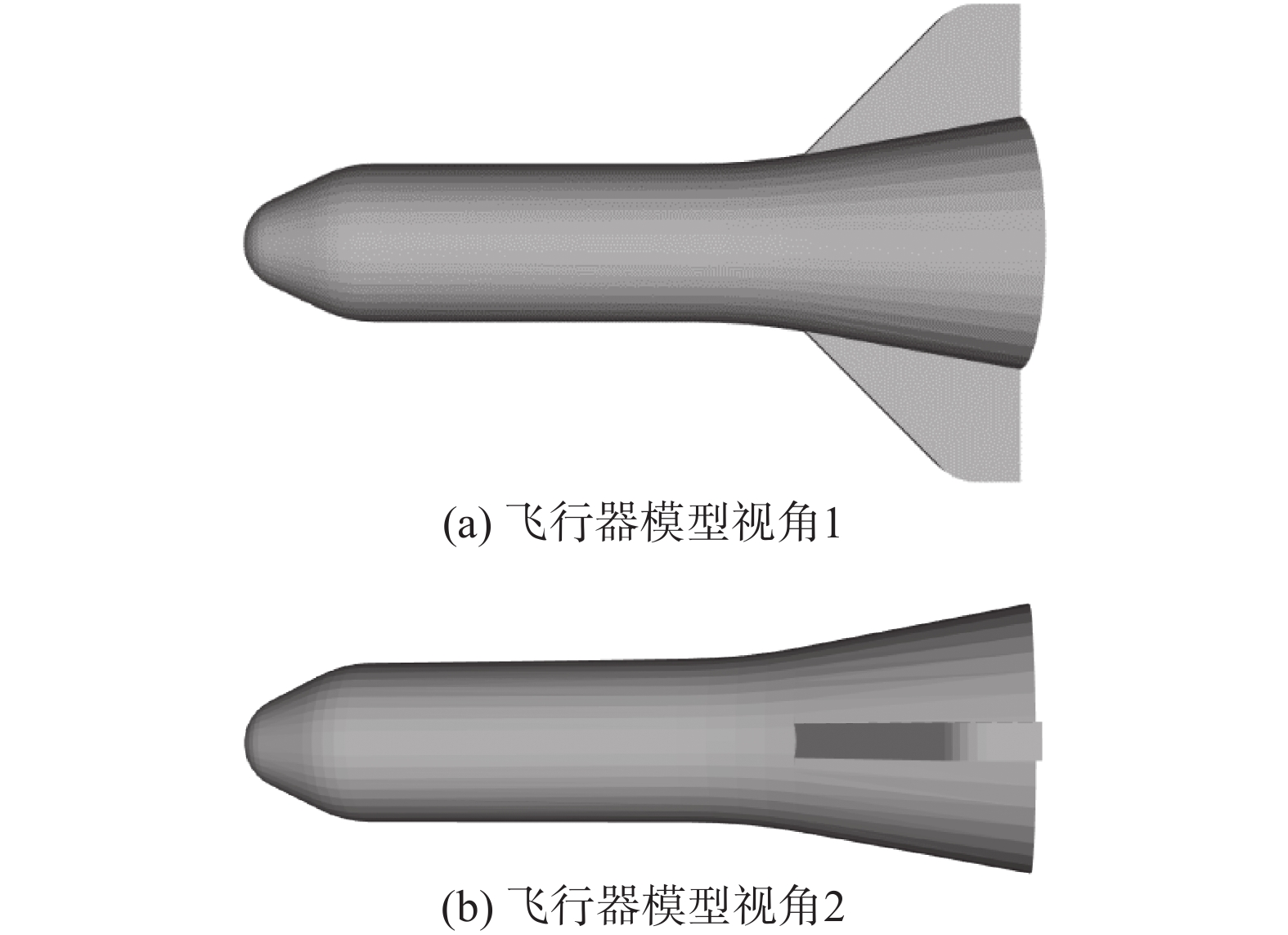

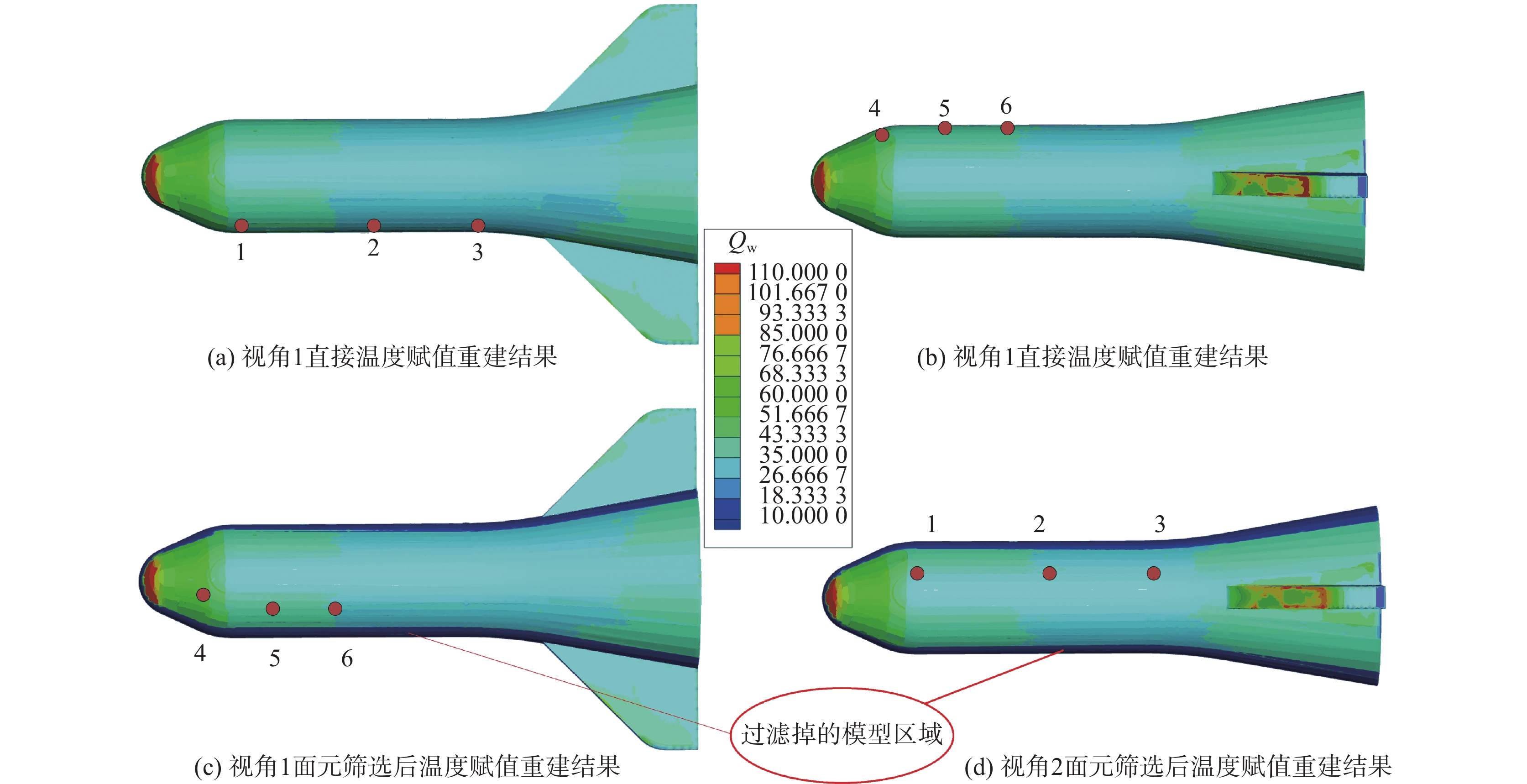

基于以上方法对一种飞行器模型表面进行三维温度场重建。此试验模型沿轴线方向对称,如图12所示。从两个相邻视角(视角1和视角2)方向对模型表面直接进行温度赋值试验,结果如图13(a)和图13(b)所示,经面元筛选后,再分别从视角1和视角2进行温度赋值试验,结果如图13(c)和图13(d)所示。

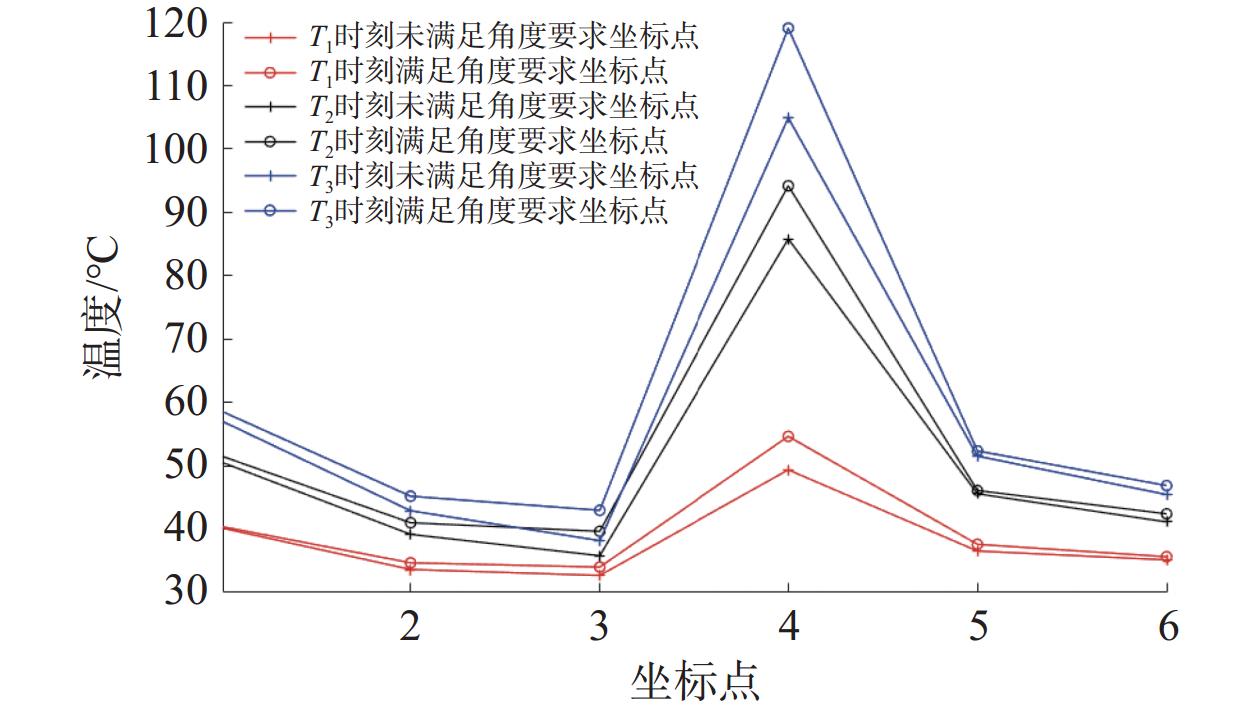

由图13可知,相对于直接温度赋值,面元筛选方法会对不符合对应视角要求的面元进行过滤。如图13(c)和图13(d)中的蓝色区域,针对这些被过滤掉的模型区域对应视角获得的温度不会对其进行赋值。图13(a)中坐标点1、2、3,根据公式(6)可知,在视角1下处于不满足视角要求的区域,但是如图13(d)所示,坐标点1、2、3满足视角2的视角要求。因此,飞行器表面1、2、3处的温度值,可由视角2所采集数据赋值。同理可得,坐标点4、5、6点处也不满足视角2的视角要求,但是在相邻的视角1中满足视角要求。因此,可由视角1所采集数据,对飞行器表面4、5、6处的温度赋值。对上面的6个坐标点在不同时刻视角1和视角2下的温度值进行对比,结果如图14所示。

图14可知,相比于满足视角要求下获得的温度值,坐标点在不满足拍摄视角阈值下获取的温度会降低,故利用面元筛选方法过滤掉测温不准的飞行器模型区域可以提高三维温度场的重建精度。

将参考网格法[11,14]作为对照方法进行对比试验。网格布置如图15所示。此方法通过模型在冷态时与风洞试验条件下保持同一位置,通过网格定位,建立模型物面位置与像素之间的对应关系。但是由于模型快速送进装置的震动、摩擦减阻等原因使得模型位置难以在这两种条件下完全重合。将网格交叉点设定为参考点,计算参考网格法与本文重建方法参考点的偏移误差。参考网格法参考点的平均偏移误差为1.86 pixel,而本文重建方法参考点平均偏移误差为1.12 pixel,所以本文的重建方法在精度上更有优势。

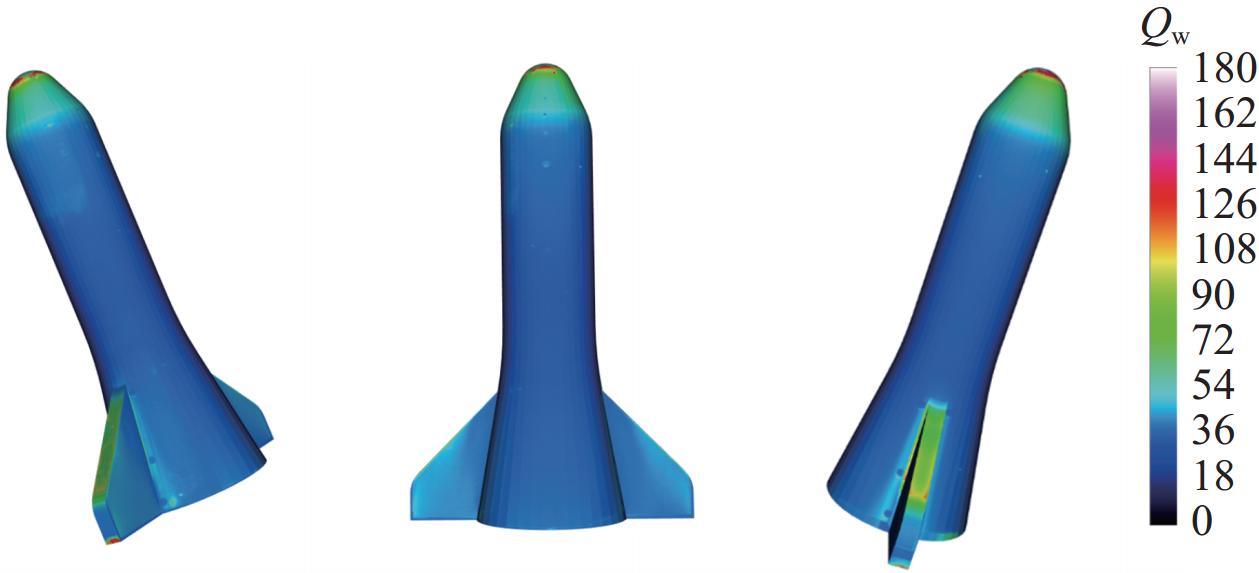

在上述试验基础上,开展以下三维温度场重建试验。把风洞测热试验获取的模型4个视角的红外图像作为纹理图案,如图16所示,利用投影关系及面元筛选方法,通过纹理映射将红外图像映射到飞行器模型表面[17]。多次映射后得到T1时刻重建结果如图17所示。

图17中,颜色条的温度变化由黑色低温到白色高温。红外图像映射到模型表面后完成三维温度场重建,飞行器模型表面温度分布相对于二维红外图像显得更加立体和直观。飞行器的前端和舵翼迎风面是高温区域,前端部分越靠近尖端温度越高,其他部分是温度相对较低的区域。飞行器各区域的温度值符合重建后显示的对应温度值。

3. 结 论

本文针对风洞试验中红外图像分辨率低和测试角度限制导致的飞行器模型表面三维温度场重建精度不足问题,提出了一种有效的重建方法:针对红外图像对比度和分辨率低导致特征点识别率低的问题,采用一种基于多帧图像的处理算法使特征点的识别率达到96.875%;针对红外热像仪测试角度超过自由极角导致的测温失准问题,提出一种飞行器模型面元的筛选方法,筛选掉飞行器模型上测温不准的区域,再通过温度赋值方法对飞行器进行温度赋值,使得重建的目标温度场更加精准。

本文的重建方法在飞行器模型表面三维温度场重建研究中有潜在应用价值。后续研究将针对测温失真问题研究更加准确的温度赋值方法,进一步探究该方法对温度场重建精度的提升效果。

-

表 1 不同视角下不同帧数红外图像的特征点识别结果

Table 1 Feature point recognition results of infrared images with different frame rates from different perspectives

1帧红外图像 3帧红外图像 5帧红外图像 10帧红外图像 20帧红外图像 运行时间/s 识别率/% 运行时间/s 识别率/% 运行时间/s 识别率/% 运行时间/s 识别率/% 运行时间/s 识别率/% 视角1 0.117 87.5 0.343 100 0.576 100 1.136 100 2.143 100 视角2 0.145 75 0.324 87.5 0.502 100 1.202 100 2.342 100 视角3 0.149 75 0.314 100 0.551 100 1.153 100 2.135 100 视角4 0.105 75 0.255 87.5 0.479 87.5 1.067 88.75 2.140 91.25 平均 0.129 78.125 0.309 93.75 0.527 96.875 1.139 97.187 2.190 97.812 表 2 不同算法特征点识别结果

Table 2 Recognition results of feature points using different algorithms

参数 NCC算法 卷积神经网络 本文特征点识别算法 运行时间/s 3.625 1.782 2.102 平均识别率/% 93.75 93.75 96.875 -

[1] 李明, 杨彦广, 祝智伟. 利用红外热图开展通用航空飞行器气动热特性试验[J]. 红外与激光工程, 2013, 42(2): 285−289. doi: 10.3969/j.issn.1007-2276.2013.02.002 LI M, YANG Y G, ZHU Z W. Experiment of the characteristic of aerodynamic heating on CAV using infrared thermograpy[J]. Infrared and Laser Engineering, 2013, 42(2): 285−289 (in Chinese). doi: 10.3969/j.issn.1007-2276.2013.02.002

[2] PARK S Y, SUBBARAO M. Automatic 3D model reconstruction based on novel pose estimation and integration techniques[J]. Image and Vision Computing, 2004, 22(8): 623−635. doi: 10.1016/j.imavis.2004.01.002

[3] MARULLO G, TANZI L, PIAZZOLLA P, et al. 6D object position estimation from 2D images: a literature review[J]. Multimedia Tools and Applications, 2023, 82(16): 24605−24643. doi: 10.1007/s11042-022-14213-z

[4] ULRICH M, WIEDEMANN C, STEGER C. Combining scale-space and similarity-based aspect graphs for fast 3D object recognition[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(10): 1902−1914. doi: 10.1109/TPAMI.2011.266

[5] 吴鹏, 徐洪玲, 宋文龙. 结合小波金字塔的快速NCC图像匹配算法[J]. 哈尔滨工程大学学报, 2017, 38(5): 791−796. doi: 10.11990/jheu.201512022 WU P, XU H L, SONG W L. A fast NCC image matching algorithm based on wavelet pyramid search strategy[J]. Journal of Harbin Engineering University, 2017, 38(5): 791−796 (in Chinese). doi: 10.11990/jheu.201512022

[6] RUSU R B, BRADSKI G, THIBAUX R, et al. Fast 3D recognition and pose using the Viewpoint Feature Histogram[C]// 2010 IEEE/RSJ International Conference on Intelligent Robots and Systems, Taipei, China. IEEE, 2010: 2155-2162. doi: 10.1109/IROS.2010.5651280

[7] WOHLHART P, LEPETIT V. Learning descriptors for object recognition and 3D pose estimation[C]// 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Boston, MA, USA. IEEE, 2015: 3109-3118. doi: 10.1109/CVPR.2015.7298930

[8] 吴毅红. 基于图像的相机定位技术综述[J]. 人工智能, 2019, 6(2): 50-64. WU Y H. A survey on image-based camera localization techniques[J]. AI-View, 2019, 12(2), 45-53 (in Chinese). doi: 10.16453/j.cnki.issn2096-5036.2019.02.005

[9] ABDEL-AZIZ Y I, KARARA H M, HAUCK M. Direct linear transformation from comparator coordinates into object space coordinates in close-range photogrammetry[J]. Photogrammetric Engineering & Remote Sensing, 2015, 81(2): 103−107. doi: 10.14358/PERS.81.2.103

[10] RIECK M Q. An algorithm for finding repeated solutions to the general perspective three-point pose problem[J]. Journal of Mathematical Imaging and Vision, 2012, 42(1): 92−100. doi: 10.1007/s10851-011-0278-y

[11] 李明, 祝智伟, 李志辉. 红外热图在高超声速低密度风洞测热试验中的应用概述[J]. 实验流体力学, 2013, 27(3): 108−112. doi: 10.3969/j.issn.1672-9897.2013.03.021 LI M, ZHU Z W, LI Z H. The summarization of infrared thermography on aerodynamic heating measurement in hypersonic low density wind tunnel[J]. Journal of Experiments in Fluid Mechanics, 2013, 27(3): 108−112 (in Chinese). doi: 10.3969/j.issn.1672-9897.2013.03.021

[12] 张志强, 王萍, 赵三军, 等. 目标距离与角度对红外热成像仪测温精度影响分析[J]. 天津大学学报(自然科学与工程技术版), 2021, 54(7): 763−770. ZHANG Z Q, WANG P, ZHAO S J, et al. Influences of target distance and angle on temperature measurement accuracy of infrared thermal imager[J]. Journal of Tianjin University (Science and Technology), 2021, 54(7): 763−770 (in Chinese).

[13] POLYANSKIY M N. Refractiveindex. info database of optical constants[J]. Scientific Data, 2024, 11: 94. doi: 10.1038/s41597-023-02898-2

[14] 祝智伟. 风洞稀薄气动热试验测试技术研究[D]. 重庆: 重庆大学, 2019. ZHU Z W. Study on test technology of thin aerodynamic thermal test in wind tunnel[D]. Chongqing: Chongqing University, 2019(in Chinese).

[15] 汪首坤, 赵金枝, 姜明, 等. 基于圆形阵列标定板的张氏相机标定法[J]. 北京理工大学学报, 2019, 39(8): 859−863. WANG S K, ZHAO J Z, JIANG M, et al. Zhang’s camera calibration method based on circular array calibration board[J]. Transactions of Beijing Institute of Technology, 2019, 39(8): 859−863 (in Chinese).

[16] 杨浩宇, 张尚盈, 肖莉, 等. 自动精确提取圆形标志点中心的相机标定研究[J]. 电子测量技术, 2021, 44(19): 155−160. YANG H Y, ZHANG S Y, XIAO L, et al. Research on camera calibration for automatic and accurate extraction of circular marker center[J]. Electronic Measurement Technology, 2021, 44(19): 155−160 (in Chinese).

[17] FU Y P, YAN Q G, LIAO J, et al. Joint texture and geometry optimization for RGB-D reconstruction[C]// 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Seattle, WA, USA. IEEE, 2020: 5949-5958. doi: 10.1109/cvpr42600.2020.00599

下载:

下载: